Die Künstliche Intelligenz, so wie wir sie heute kennen, ist noch nicht sehr alt. Wir befinden uns noch am Anfang und die Systeme entwickeln sich rasant schnell weiter. Die rasante Entwicklung zeigt sich daran, dass «nano banana» zum Zeitpunkt des Textes noch nicht öffentlich verfügbar war – sich inzwischen aber zu einem echten Gamechanger zu entwickeln scheint. In diesem Beitrag geht es um die Fortschritte der Künstlichen Intelligenz in den letzten Jahren. Wir zeigen, was heute mit KI möglich ist und wie weit man gehen kann, um sie im Alltag sinnvoll und hilfreich einzusetzen. Dabei verlassen wir uns nicht auf die Aussagen der Marketing-Abteilungen von ChatGPT & Co., sondern haben verschiedene Anwendungsfälle aus unserem Berufsalltag getestet. Die Resultate veranschaulichen wir anhand praktischer Beispiele.

Wie alles begann

In den letzten rund fünf Jahren hat sich Künstliche Intelligenz rasant entwickelt und drei Bereiche besonders stark geprägt: Text, Bild und Video. 2019 erlangten die Text-KIs von OpenAI sehr grosse Aufmerksamkeit, als Microsoft eine Milliarde Dollar in das Unternehmen investierte und damit das Training grosser Sprachmodelle auf Azure-Servern ermöglichte. Daraus entstand GPT-2, ein Modell, das Texte schreiben, Fragen beantworten, übersetzen und sogar Code generieren konnte, auch wenn es bei Fakten und längeren Zusammenhängen noch oft ungenau war. Parallel dazu entwickelte Google mit BERT eine neue Grundlage für die Suche und mit T5 ein leistungsfähiges Textmodell. Der für die breite Bevölkerung grosse Durchbruch kam 2022, als mit ChatGPT erstmals eine Text-KI für alle frei zugänglich wurde. Plötzlich konnte man einfach mit einer Maschine sprechen und nützliche Antworten in natürlicher Sprache erhalten. Auch andere Firmen wie Google mit LaMDA oder Anthropic mit Claude brachten eigene Systeme hervor, die seither immer präziser, vielseitiger und im Alltag nutzbarer geworden sind.

Fast zeitgleich erlebte auch die Bild-KI ihren Aufstieg. Modelle wie DALL·E 2 und Stable Diffusion sorgten 2022 für grosses Aufsehen, weil sie aus simplen Texteingaben realistische, künstlerische oder fantasievolle Bilder erzeugen konnten. Während DALL·E 2 durch Bildqualität überzeugte, führte die Offenheit von Stable Diffusion zu einer weltweiten Community, die das Modell laufend verbesserte und neue Werkzeuge hervorbrachte. Eines der ersten KI-Modelle, die wir im Unternehmen zur Bildgenerierung genutzt haben, war Midjourney, eine damals noch erstaunlich gute KI, die vielen weit voraus war. Seither sind Bild-KIs aus Design, Marketing, Kunstprojekten und sogar Internet-Memes kaum mehr wegzudenken. Längst geht es nicht mehr nur um das Erzeugen neuer Bilder, sondern auch um Bearbeitung, Kombination und stilistische Veränderungen – und all das allein gesteuert durch Sprache.

Etwas später, aber mit ebenso grosser Dynamik, kam die Video-KI ins Spiel. Erste Tools konnten kurze Clips aus Text erzeugen oder bestehendes Material automatisch bearbeiten. Fortschritte bei Gesichtsanimationen, Deepfakes und Erklärvideos zeigten das Potenzial. 2024 folgte dann ein weiterer Meilenstein: Modelle, die aus einem einzelnen Bild und einer kurzen Beschreibung ganze Videosequenzen erschaffen konnten. Im Vergleich zu Text- und Bild-KI steckt die Videotechnologie zwar noch sichtbar in den Anfängen, doch sie entwickelt sich aktuell am schnellsten und eröffnet neue Möglichkeiten für Filmproduktion, Werbung und digitale Kommunikation.

Es ist vieles passiert und die KI-Modelle sind schon weit gekommen.Schauen wir doch einmal genauer hin, welche Möglichkeiten KIs heute bieten. Wie schlagen sie sich in alltäglichen Szenarien aus der Sicht eines IMDlers? Wir haben den KIs Aufgaben gestellt, die wir im Workflow als Designer oft brauchen, wie z. B. einfach und schnell ein Bild erstellen.

Bild-KI-Aufgabe

Wir haben den unten stehenden KI-Modellen die gleiche Aufgabe gestellt durch einen Prompt. Ein Prompt beschreibt der KI genau, was sie machen soll und wie das Endergebnis sein sollte. Die gestellten Prompts sind eher einfacher geschrieben, um darzustellen, wie sich die KI im Alltag schlägt. Zu erwähnen ist, dass wir die aktuellen Gratis-Modelle der jeweiligen KIs genutzt haben und das Ergebnis, welches hier gezeigt wird, das erste Bild ist, welches die KI uns gegeben hat, ohne Anpassungen.

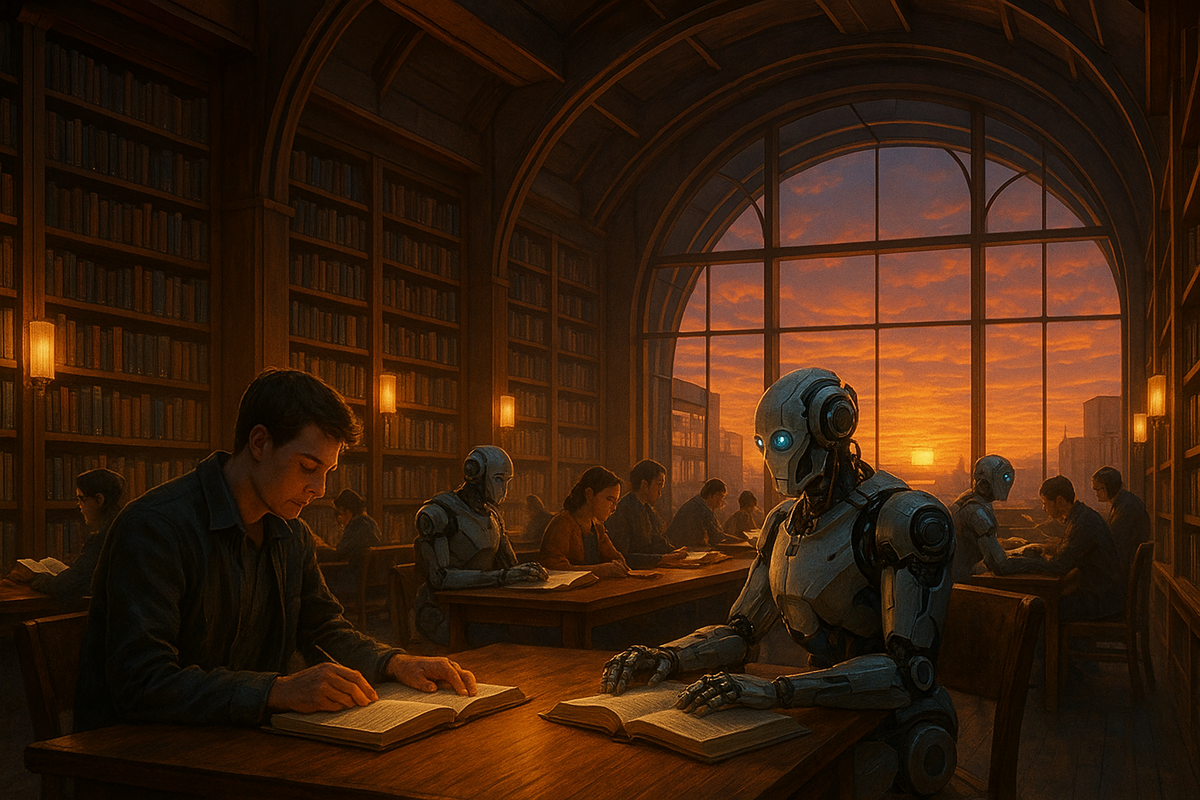

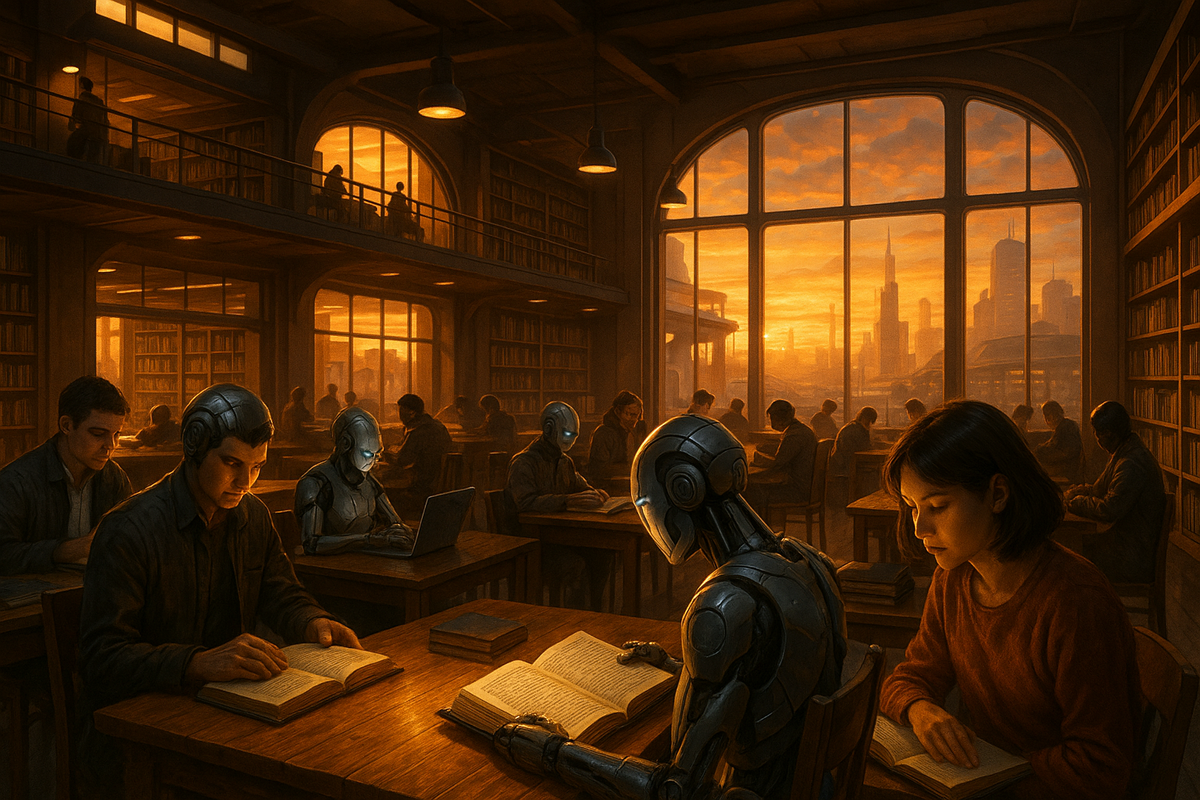

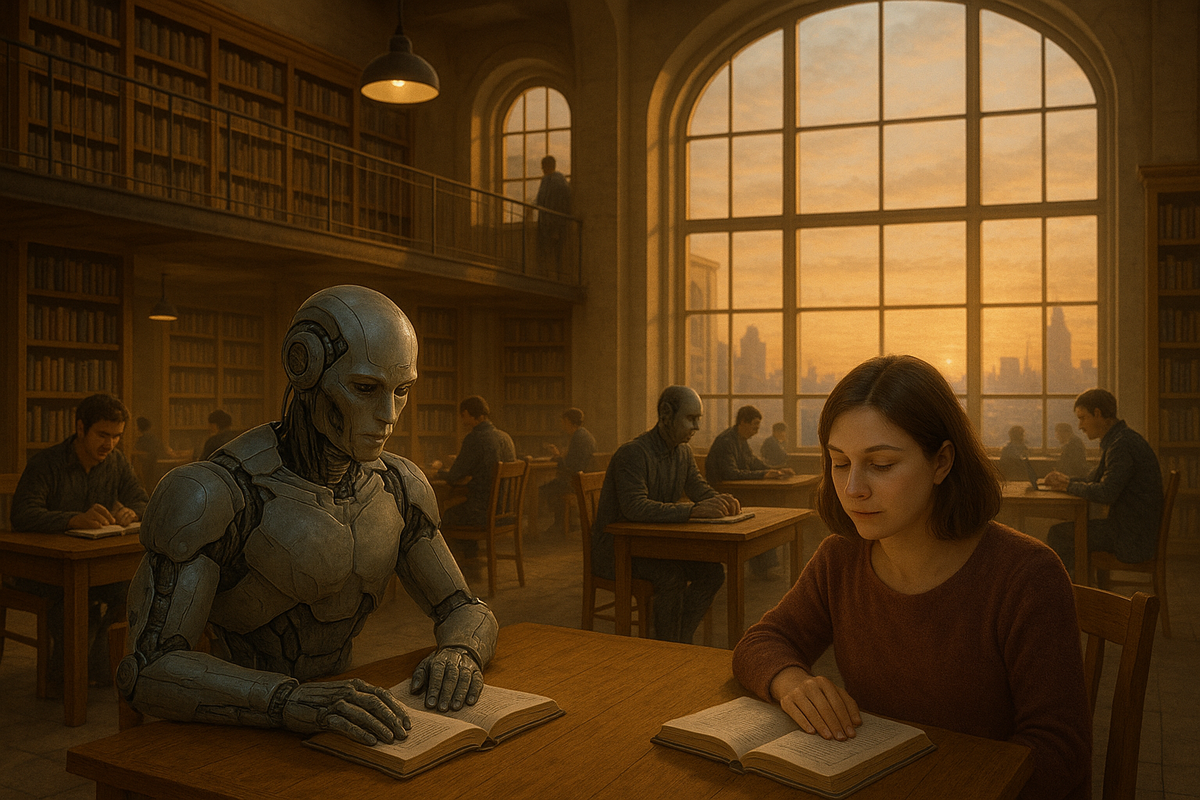

Prompt: Erstelle ein Bild: eine futuristische Bibliothek bei Sonnenuntergang, in der Menschen und Roboter gemeinsam lernen. Warmes Licht fällt durch grosse Fenster, der Stil ist realistisch mit leichtem Science-Fiction-Einschlag.

ChatGPT-4o

ChatGPT 5

Midjourney

Microsoft Copilot

Fazit

Man kann deutlich erkennen, welche KI-Modelle die Aufgabe gut verstanden haben und welche nicht. Erstaunlich schlecht war Midjourney. Midjourney war am Anfang, als die Bilder-KIs entstanden, weit voraus, doch jetzt sehen die Bilder nicht wirklich realistisch aus und es hat den Prompt offensichtlich nicht gut verstanden.

ChatGPT-4o hingegen hat ein sehr gutes Bild gemacht und aus schon einem einfachen Prompt ein tolles Bild gemacht. Es hat die Anweisung wie «Mensch lernt mit Roboter» verstanden und eine realistische, aber doch futuristische Bibliothek erstellt.

Das neuere ChatGPT-5-Modell war jedoch etwas enttäuschend. Man würde ja denken, ein neueres Modell sei besser, aber nein. Die Person rechts ist völlig fehl am Platz und die Gesichter der Personen und Roboter sind schlechter als bei ChatGPT-4o.

Der Microsoft-Copilot hat auch gezeigt, dass der Prompt verstanden wurde, und das Bild zeigt eine sehr futuristische Bibliothek, in der Menschen mit Robotern arbeiten. Jedoch sind die Gesichter und Details wie Hände definitiv schlechter als bei ChatGPT. Somit ist das Bild eher schlechter brauchbar.

Aus meiner Sicht als Designer wären alle Bilder bis auf die von Midjourney und Copilot gut zu gebrauchen. Man könnte noch durch kleine Nachverbesserungen ein besseres und sicher brauchbares Bild generieren. Die kann man brauchen für z. B. Füllbilder auf einer Website oder auf Social Media.

Dieses Experiment zeigt auch: Neuere Modelle sind nicht in allen Anwendungsfällen zwingend besser als ältere und die Dynamik bei der Weiterentwicklung ist enorm: Die Platzhirsche werden innert kürzester Zeit von von der Konkurrenz überholt.

Nach mehreren neuen Versuchen konnte mir ChatGPT 5 ein etwas besseres Bild geben, aber es ist definitiv immer noch nicht perfekt.

Video KI Aufgabe

Weiter mit der Video Aufgabe. Video KIs sind noch nicht so weit und Gratis ein gutes Ergebniss zu bekommen ist schwierig. Trozdem möchten wir es veruchen um zu schauen ob es überhapt jetzt schon möglich wäre KI Videos einzusetzen.

Prompt: Ein Kind läuft an einem Sommertag durch ein Sonnenblumenfeld, die Kamera folgt in leichter Zeitlupe und der Himmel ist leicht bewölkt.

Runway

Sora

Fazit

Hier kann man klar die Schwäche der KI erkennen. Runway ist schon deutlich besser als Sora und doch kann man noch klar sehen, dass es KI ist. Die klassischen Fehler wie Hände oder Haare verraten das. Wenn man wirklich etwas Gutes möchte, muss man einen sehr guten Prompt haben und dann lange nachbessern, bis es einigermassen den ursprünglichen Vorstellungen entspricht. Ja, die Videos sehen schon einigermassen gut aus, aber es sind maximal die ersten 2–3 Sek. brauchbar, bis dann das Kind komisch hochspringt und alles verzerrt.

Brauchbar wäre eines dieser Videos aus meiner Sicht nicht. Es müsste länger sein und Details wie Hände etc. müssten sicher besser sein.

Video-KIs sind wirklich noch ganz am Anfang, aber auch da ist die Entwicklung schnell und es kann sein, dass wir schon in 1 Jahr bessere Gratis-Ergebnisse sehen können.

Wie geht es weiter?

KI ist heute schon erstaunlich weit gekommen. Texte, Bilder und Videos lassen sich mit wenigen Worten erzeugen und für viele Zwecke nutzen. Trotzdem stehen wir erst am Anfang. Die Systeme entwickeln sich schnell weiter und werden von Jahr zu Jahr besser. Gerade jetzt zeigt sich, wie wichtig es ist, KI bewusst einzusetzen: als Werkzeug, das uns inspiriert, unterstützt und neue Möglichkeiten eröffnet. Die nächsten Schritte werden spannend und wir alle sind Teil dieser Entwicklung.